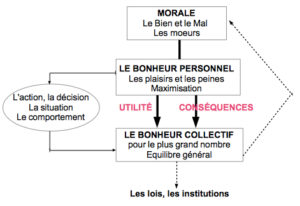

Schéma

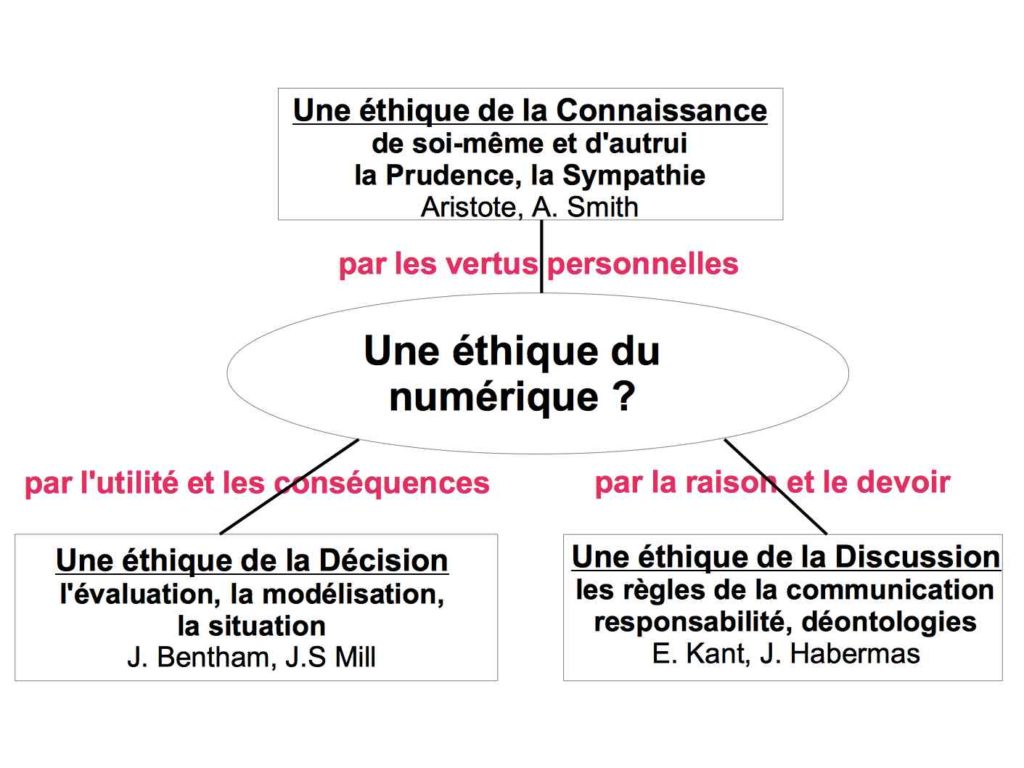

L’approche de l’éthique utilitariste met en avant l’utilité de nos actes vis-à vis du plus grand bonheur collectif, une approche assez facile pour « résoudre » les dilemmes éthiques par le solutionnisme. La question théorique devient ici: Peut-on fonder une éthique du numérique qui serait basée sur l’utilité des technologies, évaluée selon leurs conséquences?

Cette vision utilitariste, fondée par Jeremy Bentham et J. S. Mill au XVIIIe siècle, s’est opposée à l’éthique déontologique et à l’éthique de la vertu personnelle:

1. L’éthique de l’utilitarisme, selon Jeremy Bentham et John Stuart Mill

J. Bentham, philosophe anglais du XVIIIe siècle, veut s’éloigner aussi bien de la conformité à des valeurs traditionnelles ou religieuses, que de la conformité à des règles déontologiques. Car le but de la vie en société est au final assez simple : c’est le plus grand bonheur pour le plus grand nombre, « Le bonheur le plus grand pour le plus grand nombre doit fonder les mœurs et les lois » (voir Bentham 1780 Wikisource).

- si aucune autorité suprême ne peut décréter ce qui juste ou bon pour l’humanité, alors un acte particulier devient juste si et seulement si le bonheur collectif qui en résulte est augmenté. Pour J. Bentham ce bonheur peut se mesurer de façon hédoniste, par le degré de plaisir ou de peine, suivant par exemple la durée, l’intensité, la certitude, la proximité, la fécondité, l’étendue et la pureté des actions (voir Bentham 1834, traduction BNF);

- si le principe éthique devient de maximiser le bonheur collectif, alors ce sont les conséquences collectives d’un acte particulier qui comptent. Ceci permet à la fois de faire abstraction de nos intérêts (penchants, préjugés moraux, conceptions métaphysiques ou croyances religieuses) mais aussi et surtout de faire abstraction de la nature des politiques ou des institutions (voir E. de Champs 2015 sur la pensée politique de Jeremy Bentham et voir Cléro 2011 pour une explication très intéressante du principe d’utilité).

Cette approche de l’éthique peut être qualifiée de pragmatique, de formalisable et de téléologique:

- très pragmatique, puisque l’on peut décider ce qu’il faut faire en évitant les débats sur la bonne conscience personnelle ou sur le rôle à donner à des institutions: les notions de personne et de devoir perdent leur caractère absolu pour n’être plus que relatives à des situations.

- très formalisable, en classant les solutions les plus utiles au bonheur: calcul d’un ratio, analyse de risques, résolution logique d’un dilemme, calcul d’impact, balance coûts/avantages, classement multi-critères… La force du principe d’utilitarisme est qu’il est seul des principes à pouvoir « résoudre » ainsi, même provisoirement, les inévitables conflits sur les principes et sur les valeurs – à condition de ne pas regarder de trop près le sort réservé au petit nombre – (Cléro, 2011). ;

- très téléologique (c’est à dire orientée vers un but), puisque ce qui compte c’est le bonheur général (et donc la fin peut justifier les moyens, notamment les moyens technologiques numériques). Dans certaines situations, peut-on alors tolérer un mal pour un bien? C’est possible, si au final le bonheur général est plus grand: l’agrégation de bonheurs particuliers maximisera l’équilibre du bonheur général, une vision s’accordant bien avec la vision libérale de l’homo economicus.

Au moins deux questions se posent alors :

- une question de définition des plaisirs et des peines : comment éviter les critiques classiques contre l’hédonisme : le cynisme, l’absence de compassion… et notamment l’iniquité d’une évaluation « majoritaire » du bonheur collectif ? On doit à John Stuart Mill, filleul de J. Bentham et philosophe économiste classique, une défense plus sophistiquée de l’utilitarisme (voir Hieu 2012) en différenciant notamment la qualité des plaisirs: plaisirs inférieurs de la satisfaction facile et plaisirs supérieurs du plus difficile bonheur de l’esprit (tels que la créativité ou la spiritualité, Mill 1863, chapitre 2, traduction Wikisource) ;

- une question de mesure des conséquences. Comment éviter les critiques sur l’irréalisme des évaluations : prévoir toutes les éventualités possibles ? envisager les conséquences plus éloignées dans l’espace ou dans le temps? envisager toutes les solutions? s’accorder sur les quantités et les qualités de plaisir ou de peine ? faire la différence l’utilité à court terme et à long terme? Il serait alors au moins nécessaire de réévaluer systématiquement nos décisions, dans une approche itérative (voir La rationalité « limitée »).

.

2. Une éthique du numérique, fondée aujourd’hui sur l’utilitarisme ? Pour une éthique de la DECISION

Une éthique du numérique en réseau a la particularité de concerner des situations contradictoires (conflits, déviances, dilemmes, paradoxes…) associant:

- le comportement des individus (l’action numérique est toujours une forme « d’écriture » dont la trace est enregistrée, Rosati 2012, et donc contrôlée, Eynard 2012 );

- et le comportement propre de technologies numériques ambivalentes (à la fois une solution et un problème, un remède et un poison : un Pharmakon selon B. Stiegler 2007) et devenues autonomes (à la fois inventives et auto-régulées en elles-mêmes, voir Intelligence artificielle et modèles de décision, et souples et génératives dans leur usage, voir la Sociomatérialité).

Si on adopte alors les principes de l’éthique utilitariste, la priorité ne serait pas de commencer par la définition de règles universelles d’action ou par le développement de la vertu personnelle, mais de commencer par respecter un processus éthique de décision pour l’évaluation des conséquences.

Dans une éthique utilitariste une technologie numérique est utile et juste en fonction de ses conséquences,

un comportement éthique tiendrait alors à une prise de décision éthique SUR ces conséquences

Premier point. Raisonner en termes d’utilité et de conséquences offre une solution assez facile (et sans doute même la seule, selon Cléro 2011) dans les situations de conflits de valeurs ou de principes. Or la liste de ces dilemmes éthiques devient justement de plus en plus variée, au gré des innovations toujours plus « disruptives » :

- financer un service « gratuit »… en acceptant le croisement des données personnelles qui créent des « bulles informationnelles » (pour capter l’attention et définir les choix possibles) ? Voir Gouvernance algorithmique;

- orienter les individus dans la « bonne direction »… en acceptant l’utilisation des techniques de nudges (ces légers coups de coude, pour forcer l’attention et modifier nos comportements)? Voir Économie comportementale;

- « optimiser » les algorithmes de recrutement… en acceptant l’utilisation de données qui créent des discriminations ? Voir Zuiderveen-Borgesius 2018;

- accepter qu’Amazon puisse transférer sa technologie de reconnaissance faciale… à la police des USA ? Voir TheVerge 2019;

- couvrir la planète de matériels et d’infrastructures numériques… malgré l’empreinte énergétique et les déchets toxiques ? Voir F. Rodhain (2019) sur « La nouvelle religion du numérique »;

- organiser la vie des enfants devant leurs écrans… malgré toutes les études sur « La fabrique du crétin digital »? Voir M. Desmurget (2019) dans cette note de lecture de A. Fischetti;

- (on pourra éviter ici le trop fameux « dilemme du tramway » remis à jour avec la voiture autonome, puisque ce dilemme ne se posera en fait jamais : ni un homme ni une machine n’aurait le temps de délibérer sur les conséquences dans une situation particulière; la seule chose possible à faire ayant donc été de programmer le même réflexe évident que celui de l’automobiliste: sauver d’abord un piéton ou cycliste, sauver ensuite les passagers d’un véhicule, sauver en dernier lieu un objet).

Deuxième point. Une distinction théorique pour une éthique de la décision sur les conséquences devrait alors au moins être faite sur la base des trois grandes rationalités qui sous-tendent la prise de décision (voir la carte générale des théories en management des S.I.).:

- éthique dans la « rationalité limitée » du processus de décision : processus de réévaluation systématique des décisions, dans une approche itérative qui met l’emphase sur l’intelligence du problème (et pourrait se traduire alors en exigences de conception : Problem finding avant Problem solving), voir par exemple l’utilisation des matrices éthiques (Kermisch 2016) ou des retours d’expériences (Lahoual et Fréjus 2018)… et voir le texte ici important de H. Simon en 1971 sur le Style in design ;

- éthique aussi dans la « rationalité absolue » de l’optimisation : utilisation d’analyses multi-critères pour le choix de compromis, étude de seuils, utilisation de modèles d’éthique basés sur une « grammaire morale » formelle (Guizol et Baddoura 2018), intégration de règles d’éthique dès la conception des systèmes multi-agents (Berreby et al. 2018)…

- éthique enfin dans la « rationalité située » de la décision collective : attention collective pour une sensibilité aux détails et aux expériences, vigilance collective pour une anticipation des erreurs ou des évènements imprévus, évaluation collective du sens des « scripts de conception » (par exemple sur les prescriptions, restrictions, artifices, nudges… qui orientent en fait les interprétations des utilisateurs)…

Selon Y. Pesqeux (2020-a, page 26) les modèles explicatifs les plus cités des décisions éthiques sont celui de S. Hunt et S. Vitell en marketing, celui de J. Lampe et D. Finn en audit, ceux de L. Trevino, de J. Rest, et de T. Jones en management.

.

Voir les autres théories de l’éthique: éthique déontologique et éthique de la vertu

Voir les autres théories utilisées dans le contrôle des SI

RÉFÉRENCES

Jeremy Bentham (1780), An Introduction to the Principles of Morals and Legislation

J. Bentham (1834), Déontologie, ou Science de la morale, traduction française, téléchargeable en Pdf

John Stuart Mill (1863), L’Utilitarisme, Chapitre 2, Traduction1889

E. de Champs (2015). Utilitarisme et liberté, La pensée politique de Jeremy Bentham. Revue Archives de Philosophie (Tome 78)

J.P Cléro (2011), L’utilitarisme est-il une éthique acceptable ? Revue d’études benthamiennes n° 9

P. Hieu (2012), Introduction à la morale utilitariste de John. Stuart Mill, Mémoire Université de Nantes

B. Stiegler, (2007). Questions de pharmacologie générale. Il n’y a pas de simple pharmakon. Psychotropes, vol. 13(3)

le lien et cet entretien en 2016

M. Rosati (2012), Une éthique appliquée ? Éthique publique vol. 14, n° 2

J. Eynard (2012), L’éthique à l’épreuve des nouvelles particularités et fonctions des informations personnelles, Éthique publique vol. 14, n° 2

L. Guizol, R. Baddoura (2018), CEMAA : un modèle préliminaire basé sur la variabilité des contextes éthiques, Revue d’Intelligence Artificielle, Vol. 32

D. Lahoual, M. Fréjus (2018). Conception d’interactions éthiques et durables entre l’humain et les systèmes d’intelligence artificielle, Revue d’Intelligence Artificielle, Vol. 32

F. Berreby , G. Bourgne , J-Gl Ganascia (2018), Cadre déclaratif modulaire d’évaluation d’actions selon différents principes éthiques, Revue d’intelligence artificielle n° 4

N. Desmurget (2019), La fabrique du crétin digital, Seuil

F. Rodhain (2019), La nouvelle religion du numérique: Le numérique est-il écologique ? Éditions EMS, Libre et Solidaire

Z. Zuiderveen-Borgesius (2018), Discrimination, intelligence artificielle et décisions algorithmiques, Rapport Conseil de l’Europe, 53 p.

Y. Pesqueux (2020-a). L’«école des relations humaines» et la question de la motivation, WP

Y. Pesqueux (2020-b). Ethique des Affaires: quand l’organisation se mêle de société? WP Master